Deep Nostalgia i regenerowanie źródeł historycznych

Badanie historyczne z wykorzystaniem źródeł przetworzonych przez rozmaite narzędzia AI nie musi być niepoprawne. Konieczne jest jednak odpowiednie zaznaczenie pośrednictwa oprogramowania.

W tym tygodniu wiele polskich portali i czasopism ekscytowało się nowym narzędziem udostępnionym przez portal MyHeritage. Kurier Lubelski pisał np. tak:

Masz jedno, jedyne zdjęcie swojej praprababci i nie potrafisz sobie wyobrazić tego, jak wyglądała w ruchu? Teraz możesz się o tym przekonać z pomocą Deep Nostalgia. W kilka chwil ożywisz fotografię – znajdująca się na niej osoba będzie mrugać, ruszać głową i uśmiechać się. Internauci ruszyli do sprawdzania, jak wyglądali w ruchu ich przodkowie, ale także znane osoby. [źródło]

Poza pewną nieporadnością w opisie tego, jaki jest efekt stosowania narzędzia od MyHeritage, przejrzane przeze mnie publikacje na ten temat nie wyjaśniały w żaden sposób zasady jego działania. Rozwiązania AI są coraz silniej obecne w codziennym życiu, a my nie mamy przygotowania nie tylko do ich krytycznej recepcji, ale też do poprawnego zrozumienia tego, w jaki sposób działają.

Nowe warstwy

Na stronach MyHeritage także nie dowiemy się zbyt wiele o algorytmie generującym krótkie animacje ze starych fotografii. Wiadomo, że twórcą narzędzia jest firma D-ID. Deep Nostalgia to narzędzie z oferty Reenactment Suite, obejmującej algorytmy nakładania ruchu na dwuwymiarowe porterty czy synchronizacji ruchu ust wygenerowanego portretu z nagraniem video współczesnego aktora. Ruch z nagrania “wejściowego” przenoszony jest na nagranie “wyjściowe“, w którym na dwuwymiarowy portret nakladana jest nowa warstwa. Takie przetworzenie możliwe jest dzięki głębokim sieciom neuronowym, pozwalającym na wygenerowanie tzw. “mapy ruchu“ i dodanie niezbędnych nowych piskeli - statyczny obrazek przetwarzany jest przecież w video, a to wymaga nowych elementów. Jak przekonuje D-ID, sieci neuronowe będące podstawą Deep Nostalgia “zostały wytrenowane na dziesiątkach tysięcy filmów”. Niestety nie znamy źródła tych treningowych danych, nie jest też dostępny żaden artykuł naukowy opisujący tę metodę.

Ponieważ Deep Nostalgia “ożywiać” ma fotografie historyczne, warto zastanowić się, jak tego typu rozwiązania wpływać będą na badania historyczne. O tym, że oprogramowanie pośredniczy w badaniach - także humanistycznych - wiadomo od dawna. Już to, że piszemy w Wordzie, korzystamy z Mendeley czy wyszukujemy w Google Scholar, nie pozostaje bez wpływu na to, co i jak piszemy. W przypadku Deep Nostalgia mamy jednak do czynienia z nieco bardziej zaawansowanym pośrednictwem. Nie sądzę przy tym, żeby ktokolwiek chciał badać cokolwiek z wykorzystaniem sztucznie generowanych animacji dawnych fotografii - Deep Nostalgia to raczej ciekawostka, mająca zachęcać użytkowników do korzystania z portalu My Heritage. Wartość tego portalu zależy przecież bezpośrednio od liczby użytkowników i danych rodzinnych, które tam umieszczają. Warto dodać, że serwis ten miał już problemy z zapewnieniem prywatności swoim użytkownikom (w 2018 roku wyciekły dane 90 mln osób).

Oprogramowanie przepisuje historię?

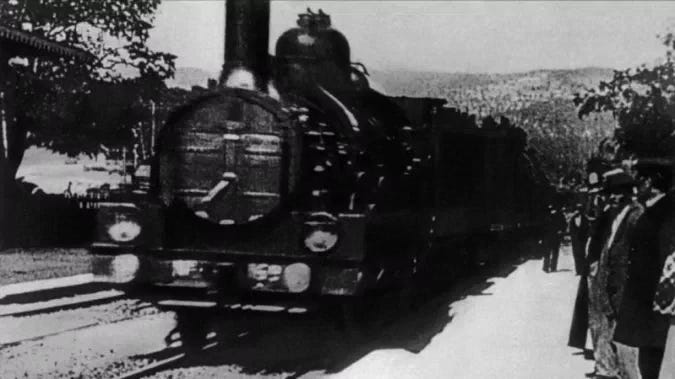

Jednak jaki status może mieć źródło historyczne regenerowane przez AI? Przykładowo, mamy oto dostęp do nagrania filmowego z 1896 roku. Nagranie w oryginalnej postaci jest bardzo złej jakości, nie widać na nim zbyt wielu szczegółów. Jednak własnościowy algorytm Gigapixel AI pozwala na takie przetworzenie nagrania, w którym jego rozdzielczość zwiększa się wielokrotnie. Algorytm “w inteligentny sposób“ dodaje do nagrania dodatkowe piskele i w ten sposób umożliwia lepsze przyjrzenie się zarejestrowanej scenie.

Regenerowane w ten sposób archiwalne zasoby wizualne czy przepisywane z wykorzystaniem uczenia maszynowego średniowieczne rękopisy mogą być użyteczne w badaniach historycznych. Korzystamy w nich wówczas jednak nie z pierwotnej postaci źródła, ale pewnej jego interpretacji. Może wydawać się, że z punktu widzenia poprawności badawczej powinniśmy unikać takiego zapośredniczania. Jednak nie jest ono niczym nowym:

współczesne teorie źródła historycznego podkreślają, że nigdy nie jest ono dane “bezpośrednio”, a raczej jest wypracowywane w ramach badania; wpływ na jego konstrukcję mają nie tylko pytania badawcze, ale też sposób myślenia osoby, która te badania podejmuje;

zwykła digitalizacja zbiorów archiwalnych również jest pewną formą interpretowania czy przetwarzania źródeł przez oprogramowanie; usunięcie warstwy materialnej ze źródła nie musi być wadą, jeśli nie interesuje nas to, co ta materialność mogłaby nam powiedzieć o przeszłości;

Badanie historyczne z wykorzystaniem źródeł przetworzonych przez rozmaite narzędzia AI nie musi być niepoprawne. Konieczne jest jednak odpowiednie zaznaczenie pośrednictwa oprogramowania. Jak to zrobić? Wystarczy odpowiedni fragment w części artykułu, poświęcony zastosowanej metodzie - i przypis do pracy naukowej, wyjaśniający zasady działania określonego narzędzia. Cytowanie oprogramowania w pracach naukowych pozwala nam w pewien sposób przerzucić odpowiedzialność za wyjaśnienie metody regenerowania źródła na twórców tej metody. Jeśli jednak zupełnie bezwiednie stosujemy takie narzędzia, wpadamy w efekt “czarnej skrzynki”.

Na koniec warto przypomnieć, że rozwiązania AI nie zawsze są neutralne etycznie. Po pierwsze, dane wykorzystywane do trenowania modeli gromadzone być mogą w sposób ignorujący prywatność (to powszechny problem np. przy algorytmach rozpoznawania twarzy). Po drugie, niektóre źródła historyczne mogą mieć specyficzny charakter - nie jestem do końca przekonany, czy etyczne jest regenerowanie wizerunków zmarłych osób, szczególnie, jeśli wciąż żyją ich bliscy. Czy Deep Nostalgia mogłaby być zastosowana do “ożywiania“ fotografii wykonywanych więźniom przy ich rejestrowaniu w obozie koncentracyjnym? Jaki cel mogłoby mieć takie ożywienie i czy rzeczywiście zostałby on spełniony? Czy pod względem poznawczym takie przetworzenie oryginalnego źródła powiedziałoby nam o cokolwiek nowego o przeszłej rzeczywistości?

ZOBACZ TAKŻE

Żadne dane nie są neutralne, te generowane z zasobów społecznych (np. z Internetu czy literatury) mogą dodatkowo replikować ujawniające się w tych źródłach stereotypy i uprzedzenia. "A Survey on Bias and Fairness in Machine Learning" to artykuł próbujący opisać typy uprzedzeń i stronniczości obecnych w danych. Ninareh Mehrabi i współautorzy zaproponowali ponad 20 typów stronniczości danych, wśród nich są te wynikające ze społecznych źródeł danych, ale też te będące efektem błędnego planowania danych i właściwości analiz statystycznych, takich jak np. Paradoks Simpsona.

PTA: cyfrowe wydania tekstów patrystycznych

Partistic Text Archive (PTA) to uruchomione niedawno archiwum/repozytorium transkrybowanych tekstów patrystycznych. Obecnie dostępne są tam pisma 10 autorów (m.in. Euzebiusza z Cezarei czy Orygenesa) - łącznie 521 tekstów. Dominują teksty w języku greckim, jest też kilka tłumaczeń na język niemiecki. Wydania cyfrowe przygotowywane są zgodnie ze standardem TEI (wersja P5), korzystać z nich można na warunkach wolnych licencji. Serwis oferuje także podstawowe narzędzia do analizy tekstu oraz zaawansowane wyszukiwanie. PTA prowadzone jest przez Berlin-Brandenburgischen Akademie der Wissenschaften.

Wikipedia @20 : historie niedokończonej rewolucji

"Wikipedia @20: Stories of an Incomplete Revolution" to publikacja zbiorowa wydana przez wydana przez MIT Press z okazji przypadającego w tym roku dwudziestolecia Wikipedii. W tomie znajdziemy m.in. opracowanie o recepcji Wikipedii w prasie, artykuły o relacjach między światem akademickim a Wikipedią czy potencjale tego projektu w całościowym, holistycznym opisywaniu wydarzeń i postaci historycznych. Przeczytać tam można także teksty poświęcone stereotypom i uprzedzieniom, ujawniającym się w treści haseł czy podejmujące problem dostępności treści Wikipedii poza infrastrukturą internetową. Książka opublikowana została w otwartym dostępie.

Praktyka ochrony zbiorów audiowizualnych (raport technologiczny)

W październiku zeszłego roku Digital Preservation Coalition wydała opracowanie podsumowujące metody i strategie ochrony zbiorów audiowizualnych. Raport przedstawia podstawowe informacje o cechach plików audiowizualnych, najlepsze praktyki w zakresie ich wieczystego zabezpieczania oraz wyzwania z tym związane, m.in. ryzyka prawne, kontrowersje etyczne, problemy wynikające z ewolucji sprzętu komputerowego czy koszty finansowe. Przygotowano także studia przypadku z Międzynarodowej Agencji Energetyki Atomowej, archiwów zespołu Marka Morrisa, znanego amerykańskiego tancerza oraz Borthwick Institute for Archives na Uniwersytecie w Yorku.

Jeśli podoba się Państwu ten newsletter, zachęcam do polecenia go znajomym. Obecnie subskrybuje go 6 osób.

Dziękuję i zapraszam na historiaimedia.org